Siri、音声アシスタント比較テストにおいて78%の正答率を記録ーー1年前から12%アップ

「Googleアシスタント」、「Siri」、「Cortana」、「Alexa」の4種類の音声アシスタントに対し、様々なジャンルにおける質問を合計800問投げかけて正答率を調査するLoup Venturesの実験において、「Siri」は78%を記録したことが明らかになった。

「Googleアシスタント」(正答率:85.5%)には及ばないものの、「Cortana」(正答率:52.4%)、「Alexa」(正答率:61.4%)を上回っている上に、1年前の測定時から正答率が12.4%も伸びていることが明らかになった。

実験データや内容には疑問が残るが、Siriは少しずつ成長しているらしい

すべての音声アシスタントは質問の認識率は98%以上となっていて、「Googleアシスタント」は100%を記録。

実験で使われた質問は「最寄りのコーヒーショップはどこ?」などの地図情報、「ペーパータオルを注文して」など買い物のサポートを始め、スケジュールの追加やデバイスの設定変更などの精度が測定された。

Siriが特に精度が高かったのは「コマンド」カテゴリ。その他のカテゴリでは「Googleアシスタント」に圧倒されるが、スマートホームや音楽などの操作に関してはAppleの音声アシスタントが最も長けているという結果になった。

【image via Loup Ventures】

AmazonとMicrosoftの音声アシスタントが想像以上に結果が悪いが、「Googleアシスタント」は「Pixel XL」、「Siri」は「iOS 11.4」が動作するiPhoneが使われていたが、「Cortana」と「Alexa」はそれぞれのiOSアプリが使われていることが影響している可能性がある。

実際、同じくLoup Venturesが実施したスマートスピーカーによる音声アシスタントの精度を比較した実験によると、「Siri」は他の音声アシスタントに惨敗している。

また、テストに使われた言語が英語であることも考慮する必要がありそうだ。個人的には日本語版のSiriがこれほど高い正答率を出せるとは思えない。

これらのことから、音声アシスタント同士の比較という意味では実験データおよび内容には少々の疑問は残るものの、「Siri」単体で見れば1年前より精度が向上していることは事実だと言える。その調子、その調子!

(via 9to5Mac)

もっと読む

YouTubeクリエイター3組がAppleを提訴。著作権動画を無断でAIトレーニングに利用した疑い

英語力ゼロ・貯金120万円で世界62カ国を巡った男の「ビジョンボード術」を体験してきた

Apple Parkに50周年記念の展示が登場、歴代の名機がズラッと並んでてめちゃくちゃエモい

Apple50周年の寄せ書きをTim Cookに送ったら、翌朝メールが届いた

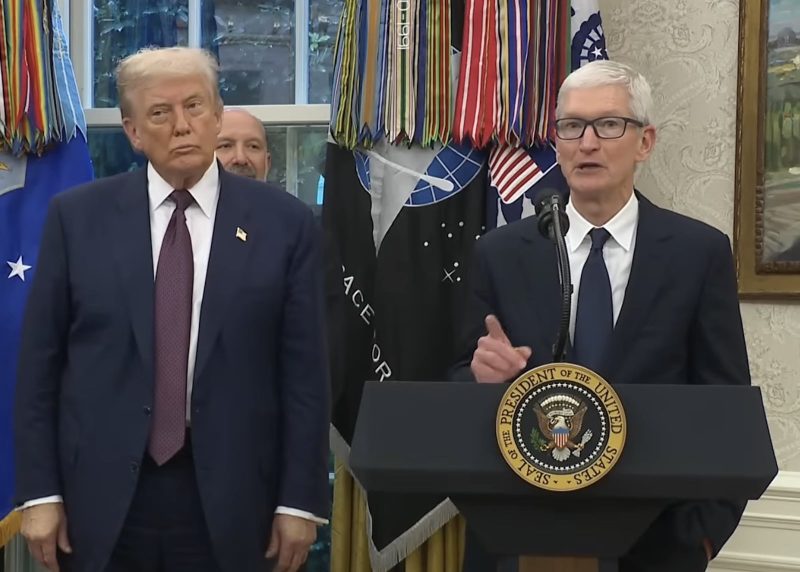

Appleの価値観は変わるのか。Tim Cookがトランプ政権との距離感を明かす

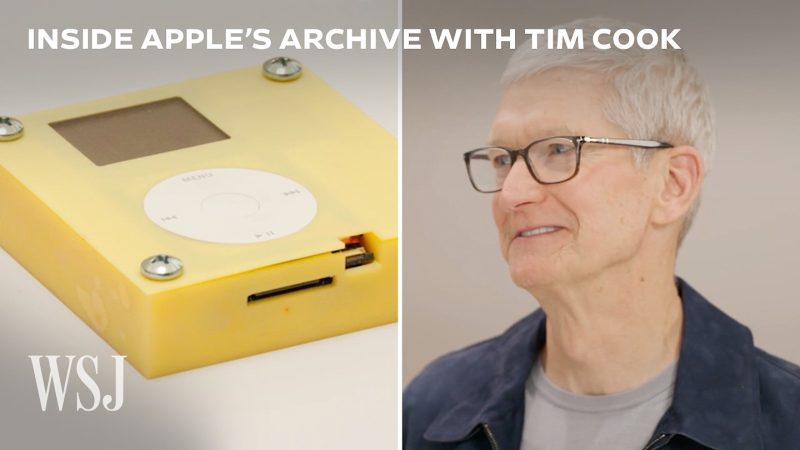

Tim Cookの”自然体”が見られる貴重映像。Apple 50周年インタビューでiPod・iPhone秘話を語る

Apple 50周年、すべての動きをまとめてお届け #Apple50th

Apple創立50周年、本日4月1日。公式サイトに特別アニメーションが登場

Apple 50周年、限定Tシャツ・ピン・ポスター配布。今夜のトリはポール・マッカートニー

イラン革命防衛隊がAppleやGoogle、Nvidiaなど米企業18社を「攻撃対象」に指定したらしい

Tim Cook、Apple創業50周年を記念してNasdaqのオープニングベルを鳴らす

Apple Fitness+に「ランニングの時間」追加。東京コースも配信

Apple50周年を「自分の人生」と重ねて振り返れるWebアプリ「My Apple 50」がすごい

Apple50周年フィナーレのヘッドライナー、ガーマン氏のヒントが意味深すぎる

Apple 50周年記念、Mori Calliopeライブレポート。表参道が”Think Different”な夜になった

Apple50周年の寄せ書きが熱すぎる。あなたの”りんごの記憶”も聞かせてほしい

Apple創業50周年、日本での記念イベントが決定。Mori Calliopeが表参道でライブパフォーマンス

Apple、企業向けデバイス管理を無料化。新プラットフォーム「Apple Business」を4月14日に提供開始

Apple 50周年のフィナーレはApple Parkか。次期CEO候補が”主役”に?